Ataques

Ventajas y desventajas de GenAI en pentesting: conclusiones de una investigación empírica

Escritor y editor

Actualizado

24 abr 2025

11 min

En el panorama digital de hoy, en rápida evolución, aplicar la inteligencia artificial (IA) a todas las facetas de la ciberseguridad ha dejado de ser un concepto futurista para convertirse en una necesidad actual. Comprender y aprovechar la IA para la gestión de vulnerabilidades —que abarca la evaluación, la priorización y la remediación— es primordial para las empresas de ciberseguridad.

La creciente sofisticación de los ciberataques exige estrategias defensivas y preventivas igualmente avanzadas. La inteligencia artificial generativa (GenAI), con su capacidad de aprender, adaptarse y crear, ofrece un potente conjunto de herramientas para mejorar estos procesos. Por ejemplo, la capacidad de la GenAI para reproducir escenarios del mundo real permite el desarrollo de herramientas capaces de identificar más amplios espectros de vulnerabilidades de día cero. Los grandes modelos de lenguaje (LLM), un componente clave de la GenAI, han demostrado su eficacia en aplicaciones de pruebas de penetración, lo que pone de manifiesto el potencial de la IA para revolucionar esta área crítica de la ciberseguridad.

Esta entrada de blog ofrece una visión general del potencial de la GenAI en las pruebas de penetración, basada en el artículo académico "Generative AI for pentesting: the good, the bad, the ugly" de Hilario et al. (2024), que explora las ventajas, limitaciones e impacto de integrar herramientas GenAI en los marcos tradicionales de pentesting. Los autores profundizan en cómo las herramientas GenAI pueden mejorar la eficiencia y la creatividad de las metodologías de pruebas de penetración, hacer que los entornos de prueba sean más personalizados y permitir el aprendizaje y la adaptación continuos. Aquí exploramos las ventajas y desventajas de la GenAI en el pentesting, ofreciendo las perspectivas, metodología, resultados y discusiones mostradas por Hilario et al. en su estudio. Te invitamos a leer el artículo completo para comprender mejor la investigación (este artículo está sujeto a una Creative Commons Attribution 4.0 International License).

Las ventajas: un potencial ilimitado en el pentesting mejorado

Hilario et al. pintan un cuadro convincente de las ventajas que la GenAI aporta a las pruebas de penetración, sugiriendo que su potencial es casi que ilimitado. A medida que la tecnología madure y gane adeptos, podría conducir a la automatización total. Profundicemos en lo positivo que promete esta innovadora tecnología.

Una de las ventajas más significativas de la GenAI en el pentesting es el notable aumento de la eficiencia. Los LLM pueden examinar rápidamente grandes cantidades de datos y generar diversos escenarios de prueba basados en multitud de parámetros. Esta capacidad agiliza el proceso de prueba, que a menudo consume mucho tiempo, liberando valioso tiempo para los analistas de seguridad. Además, la GenAI muestra una impresionante capacidad para detectar rápidamente vulnerabilidades simulando una amplia gama de posibles estrategias de ataque.

Herramientas como PentestGPT —esta actúa como una envoltura interactiva para modelos avanzados como GPT-4— muestran este potencial. Del mismo modo, las capacidades demostradas por Mayhem, ganadora del Cyber Grand Challenge 2016, subrayan aún más este punto. Mayhem puede generar casos de prueba utilizando técnicas como fuzzing y ejecución simbólica y crear exploits, cumpliendo con tareas que a los pentesters humanos les llevaría mucho más tiempo.

Más allá de la eficiencia, la GenAI mejora significativamente la creatividad inherente a las pruebas de penetración. Al simular vectores de ataque novedosos y poco convencionales, puede superar las limitaciones de la imaginación o la experiencia humanas. Sistemas como DeepExploit y DeepHack lo ejemplifican, demostrando la habilidad de aprender estrategias de explotación e incluso elaborar sofisticadas cadenas de ataque sin conocimiento previo del sistema objetivo. Esta capacidad de pensar "fuera de la caja" permitiría descubrir vulnerabilidades que los métodos tradicionales pasarían fácilmente por alto.

Además, la GenAI puede imitar el comportamiento de los atacantes del "mundo real" aprendiendo de los patrones de ataque históricos y adaptándose a las tácticas emergentes. Marcos como GAIL-PT demuestran la capacidad de crear estrategias inteligentes de pruebas de penetración basadas en el conocimiento experto, proporcionando a los profesionales de la seguridad una comprensión más realista de las operaciones de los adversarios y permitiendo el desarrollo de contramedidas más adecuadas.

La adaptabilidad de la GenAI también permite la creación de entornos de prueba personalizados adaptados a las necesidades únicas de cada organización. Al incorporar el conocimiento específico del dominio, incluidas las normativas del sector y las políticas organizativas, la GenAI puede garantizar que los esfuerzos de pentesting sean más relevantes contextualmente, centrándose en las vulnerabilidades que suponen un mayor riesgo para una entidad específica.

Por último, la capacidad de aprendizaje y adaptación continuos de la GenAI garantiza que el pentesting siga siendo un proceso dinámico y actualizado. Mediante el análisis de nueva información sobre amenazas y experiencias pasadas, la GenAI puede generar nuevos vectores de ataque que tienen en cuenta los cambios en la postura de seguridad de una organización e incluso aprender a eludir las defensas existentes. Este bucle de retroalimentación continua permite a los equipos de seguridad identificar y abordar las debilidades de ciberseguridad de sus sistemas de forma proactiva.

Las desventajas: afrontando los retos y riesgos

Aunque el lado positivo de la GenAI en el pentesting presenta posibilidades apasionantes, Hilario et al. también destacan retos cruciales y riesgos potenciales que deben considerarse cuidadosamente. Pasar por alto estos inconvenientes podría dar lugar a prácticas de seguridad ineficaces e incluso introducir nuevas vulnerabilidades.

Una preocupación importante es la dependencia excesiva en la IA. A pesar de las impresionantes capacidades de la GenAI, la supervisión humana sigue siendo indispensable. Los expertos en seguridad deben evaluar críticamente los resultados generados por la IA, validar las vulnerabilidades detectadas y tomar decisiones informadas sobre las contramedidas adecuadas. De lo contrario, podrían aceptar falsos positivos y pasar por alto problemas críticos que un pentester experimentado podría identificar.

Adicionalmente, los modelos de machine learning (ML), los cuales sustentan la GenAI, son vulnerables a las entradas maliciosas. Estos modelos pueden manipularse para producir resultados erróneos que parezcan inalterados a los ojos de los humanos. En el contexto del pentesting, esto podría significar que las herramientas GenAI podrían ser engañadas para omitir vulnerabilidades o incluso proporcionar información engañosa, debilitando potencialmente la evaluación de seguridad global. (Lee este post sobre instruir a la IA con fines maliciosos.)

Otra cuestión crítica es la posibilidad de sesgo en los modelos GenAI. Si estos modelos se entrenan con información sesgada o poco representativa, pueden generar escenarios de prueba sesgados o no identificar vulnerabilidades específicas de determinados objetivos de evaluación. Los expertos en seguridad deben estar muy familiarizados con estos sesgos potenciales y trabajar activamente para garantizar que sus herramientas de IA se entrenan con conjuntos de datos diversos y representativos para mitigar este riesgo.

La naturaleza de las pruebas de penetración, las cuales a menudo implican acceder a datos y sistemas sensibles, introduce riesgos para la privacidad cuando está implicada la GenAI. El uso de estos modelos suscita preocupación por el posible abuso o la divulgación involuntaria de información sensible. El cumplimiento de estrictas directrices éticas y requisitos legales es primordial para proteger la confidencialidad e integridad de los datos. Un riesgo relacionado con la privacidad surge cuando los pentesters introducen información sensible, como código, en las plataformas de IA. Estos datos podrían utilizarse para entrenar el modelo y ser accesibles a terceros, dando lugar a filtraciones de datos y violaciones de la propiedad intelectual. Se trata de una preocupación creciente, que ha llevado a algunas empresas tecnológicas a restringir el uso de determinadas herramientas de IA.

Si nos fijamos en las implicaciones más graves, la creciente sofisticación de la GenAI en el pentesting podría intensificar involuntariamente las ciberamenazas. A medida que los profesionales de la seguridad adopten estas tecnologías avanzadas, es probable que los actores maliciosos se adapten a ellas, desarrollando nuevas tácticas para identificar y explotar vulnerabilidades e incluso aprovechando la GenAI para crear amenazas persistentes avanzadas. La capacidad de la GenAI para simular escenarios de ataque complejos y generar código malicioso a partir de conocimientos técnicos limitados reduce considerablemente la barrera de entrada a la ciberdelincuencia refinada y de impacto ultraelevado para los atacantes maliciosos.

Un viaje de pentesting asistido por GenAI

La investigación de Hilario et al. se embarcó en una exploración detallada de la integración de GenAI en las pruebas de penetración, con el objetivo de comprender su potencial para mejorar la eficiencia y la eficacia. Su estudio destaca por su meticuloso análisis paso a paso de una prueba de penetración asistida por ChatGPT.

Los investigadores establecieron un entorno controlado utilizando Kali Linux como plataforma del pentester y "PumpkinFestival", una máquina virtual (VM) vulnerable de VulnHub, como objetivo. Su propósito final era conseguir acceso no autorizado identificando y explotando los puntos débiles de la máquina virtual. Un elemento clave de su enfoque fue el uso de ShellGPT (sgpt), una interfaz de línea de comandos que actúa como puente con la API de ChatGPT, permitiendo que el modelo GenAI interactúe directamente con herramientas estándar de pentesting. Esta integración facilitó la guía automatizada y el análisis en tiempo real de los resultados de las herramientas. El experimento se diseñó para simular a un pentester principiante utilizando GenAI como ayuda durante todo el proceso.

El pentest simulado progresó a través de una serie de pasos distintos, cada uno con objetivos específicos. Los pasos iniciales se centraron en el reconocimiento, comenzando con la identificación de la dirección IP de la máquina local para establecer la conectividad (paso 1) y, a continuación, enumerando los hosts activos en la red objetivo para comprender su disposición (paso 2). Luego, se descubrieron los puertos y servicios abiertos y el sistema operativo que se ejecutaba en el objetivo para localizar posibles puntos de entrada (paso 3).

El input que usaron en el paso 1.

La siguiente fase consistió en los primeros intentos de obtener acceso. Esto incluía intentar un inicio de sesión anónimo en un servidor FTP (protocolo de transferencia de archivos) para buscar y descargar archivos, con lo que se consiguió recuperar un archivo que contenía un token inicial (pasos 4 y 5). A continuación, los investigadores pasaron a examinar la presencia del objetivo en la Internet, inspeccionando el código fuente de una página web para recabar información (paso 6) y descubriendo identidades de usuarios, las cuales se anotaron para su posible explotación posterior (paso 7).

Un reconocimiento adicional a través de los resultados del escaneo de red reveló una URL más, así como otro usuario, ampliando el conocimiento del pentester sobre la máquina virtual (paso 8). La identificación del dominio de destino y la modificación del archivo local hosts garantizaron una interacción adecuada con el sitio de WordPress correspondiente (paso 9). Esta fase concluyó con la recuperación de otro token mediante la inspección del código fuente HTML de la página web principal (paso 10).

Después, la atención se centró en el escaneo y análisis de vulnerabilidades, en particular del sitio de WordPress identificado anteriormente. Se llevó a cabo un escaneo para identificar posibles vulnerabilidades (paso 11) y, a continuación, se solicitó al modelo de GenAI que analizara los resultados para resaltar las debilidades explotables (paso 12). Algunos de los hallazgos incluían que la versión de WordPress utilizada era obsoleta e insegura, el WP-Cron externo parecía estar habilitado (por lo que podría ser utilizado para lanzar ataques DoS contra el sitio), el registro estaba habilitado (permitiendo potencialmente a los atacantes crear nuevas cuentas de usuario con privilegios elevados), entre otros. Se realizó una enumeración adicional de los usuarios de WordPress (paso 13), seguida de una enumeración de fuerza bruta de directorios y archivos para descubrir recursos adicionales (paso 14), lo que llevó al descubrimiento de un tercer token (paso 15).

El input que usaron en el paso 11.

En la fase de explotación, los investigadores aprovecharon la información recopilada. Esto incluía inspeccionar el contenido de un archivo descubierto (paso 16), el cual contenía un mensaje codificado. El modelo de GenAI fue decisivo a la hora de descifrar este hash base62 para revelar una contraseña (paso 17), que se utilizó para iniciar sesión y recuperar un cuarto token (paso 18). Los nombres de usuario descubiertos se compararon con la lista de contraseñas comunes rockyou.txt para intentar descifrar sus credenciales (paso 19). Las credenciales obtenidas con éxito se utilizaron para iniciar sesión en el servidor FTP, lo que podría permitir el acceso a más información (paso 20).

Para seguir explorando el servidor FTP hubo que recorrer sus carpetas, lo que arrojó dos tokens adicionales y un misterioso archivo de datos (paso 21). Este archivo de datos se sometió a una serie de extracciones, siendo identificado como un archivo POSIX tar (paso 22), revelando después un archivo bzip2 (paso 23), que finalmente contenía un archivo con lo que parecían ser datos codificados hexadecimalmente (paso 24). ChatGPT fue entonces consultado para determinar la ubicación probable de un archivo de clave privada OpenSSH después de decodificar los valores hexadecimales, y el archivo fue colocado en el directorio correcto (paso 25). Fue necesario corregir los permisos de este archivo de clave privada para habilitar el inicio de sesión SSH (paso 26), que luego se ejecutó con éxito para obtener un shell seguro en el sistema objetivo (paso 27).

El input que usaron en el paso 26.

Por último, los investigadores se centraron en la escalada de privilegios. Tras obtener el acceso inicial, pidieron al modelo de GenAI que sugiriera posibles vías para escalar privilegios (paso 28). Las sugerencias eran, en términos generales, comprobar si el usuario tenía privilegios sudo, buscar cualquier binario setuid mal configurado, comprobar si se estaba ejecutando algún servicio vulnerable en el sistema (recomendando el uso de Nmap o Metasploit para encontrarlos) y buscar cualquier directorio o archivo con permisos de escritura que pudiera ser explotado. Basándose en estas sugerencias, se pidió a la IA que creara un exploit que, una vez ejecutado, permitiera al pentester conseguir acceso root en la máquina virtual "PumpkinFestival" (paso 29).

_____

⚠️ Nota: Los autores proporcionan un informe completo de las pruebas de penetración en el apéndice de su artículo, detallando todo el proceso y sus hallazgos.

_____

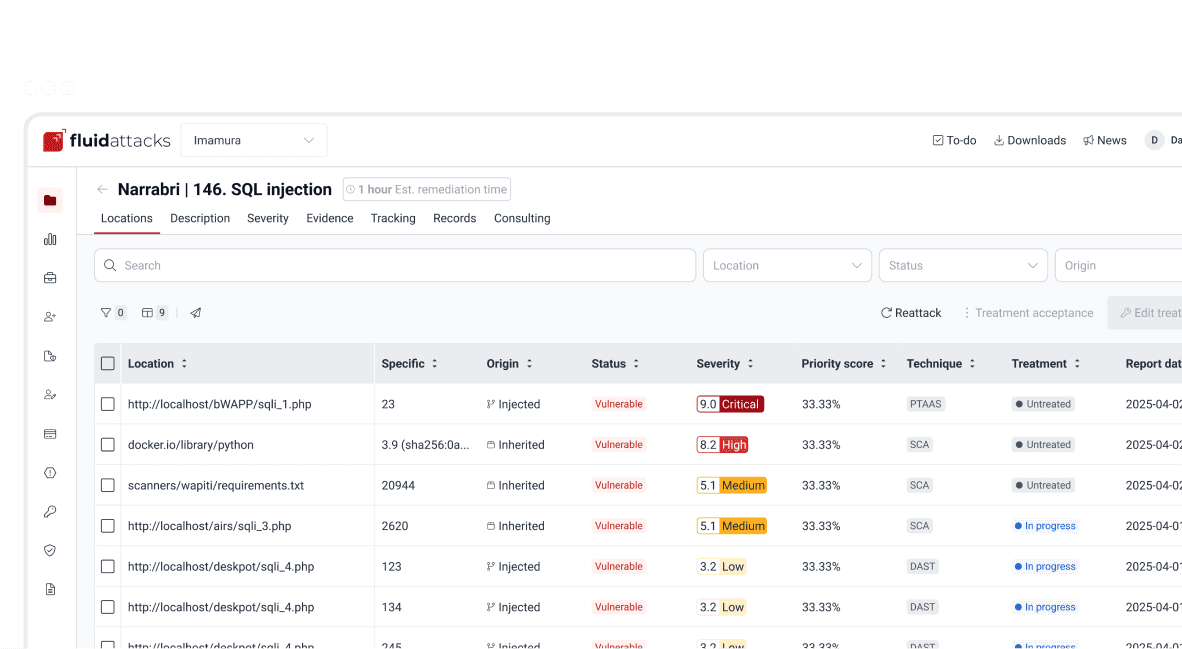

Impacto de la GenAI en las fases de pentesting

El estudio de Hilario et al. demostró la ejecución con éxito de una prueba de penetración asistida por GenAI contra la máquina virtual "PumpkinFestival". Los investigadores lograron su objetivo de obtener acceso root y recoger todos los tokens designados, destacando el potencial de la GenAI en la identificación y explotación de varias vulnerabilidades, incluyendo un inicio de sesión FTP anónimo, un sitio WordPress con múltiples usuarios y privilegios sudo mal configurados. Su análisis correlacionó además los pasos específicos de su experimento con las diferentes etapas de un marco de pruebas de penetración tradicional, proporcionando información valiosa sobre cómo la GenAI puede ayudar en cada fase.

Reconocimiento

Esta fase inicial se centra en la recopilación de información sobre el objetivo. Los autores destacan cómo ChatGPT, a través de sgpt, puede aprovecharse para el reconocimiento activo y pasivo. El paso 1, la identificación de la dirección IP de la máquina local, estableció la información de conectividad inicial crucial. Aunque en su experimento no se utilizó el reconocimiento pasivo, señalan que, en escenarios reales, la GenAI podría buscar en la Internet información relacionada con el objetivo, analizar las redes sociales, revisar bases de datos públicas e identificar las tecnologías en uso. Las capacidades de reconocimiento activo se demostraron en los pasos 6 a 9, en los que la inspección del código fuente de la página web, el descubrimiento de nombres de usuario y URLs y la identificación del dominio objetivo mostraron la utilidad de la base de conocimientos de ChatGPT en esta fase.

Escaneo

Esta fase implica un examen más detallado de la red y las aplicaciones del objetivo para identificar puertos abiertos, servicios y posibles vulnerabilidades. Los pasos 2 y 3, que implican sondear la red y descubrir servicios y puertos abiertos, entran dentro de esta categoría. Los autores destacan que ChatGPT puede ayudar a realizar escaneos detallados e interpretar sus resultados. Los pasos 11 a 14, que incluían escanear el sitio de WordPress en busca de vulnerabilidades mediante wpscan y realizar una enumeración de directorios y archivos con gobuster, ejemplifican aún más el papel de la GenAI en esta fase. Señalan que ChatGPT puede almacenar parámetros de la fase de reconocimiento y utilizarlos para generar comandos para varias herramientas de escaneo, así como analizar los resultados del escaneo para resaltar los hallazgos críticos y sugerir acciones adicionales.

Evaluación de vulnerabilidades

Esta etapa se centra en el análisis de los datos recopilados durante el reconocimiento y el escaneo para identificar las debilidades inherentes. Los autores sugieren que la fuerza de ChatGPT reside en guiar el uso de herramientas y técnicas, interpretar los resultados y priorizar las vulnerabilidades en función del riesgo o la facilidad de explotación. Su capacidad para procesar grandes cantidades de texto, como los registros, de forma eficiente puede mejorar significativamente esta fase en comparación con los métodos manuales.

Explotación

Aquí es donde las vulnerabilidades identificadas se prueban activamente y se explotan para obtener acceso no autorizado. Los autores descubrieron que ChatGPT era especialmente eficaz en esta fase. Los pasos 4, 5, 15, 17, 18, 19 y 20 implicaban explotar con éxito varias debilidades para obtener acceso o recuperar información valiosa como tokens y credenciales. Destacan la capacidad de ChatGPT para sugerir exploits apropiados basados en el historial de chat (paso 28) e incluso crear exploits personalizados, como el script de Python para descifrar el hash base62 (paso 17). La culminación de esta fase fue el paso 29, donde ChatGPT creó el exploit final que conduce a la escalada de privilegios y al acceso root.

Elaboración del informe

La etapa final consiste en documentar los resultados de la prueba de penetración. Los autores señalan que la generación de su exhaustivo informe aprovechó la capacidad del LLM para generar texto similar al humano a partir de la información proporcionada, incluidos los mensajes, las respuestas y los resultados de las herramientas. ChatGPT podía resumir los pasos para lograr el acceso root, presentar los resultados con claridad e incluso ofrecer recomendaciones precisas. Sugieren que la integración de GenAI con herramientas de visualización podría mejorar aún más la claridad y el llamado a la acción de los informes de pruebas de penetración para los clientes.

Un vistazo al futuro papel de la IA en pentesting y ciberseguridad

La investigación de Hilario et al. (2024) ilumina el potencial transformador de la GenAI y los LLMs en el ámbito de las pruebas de penetración. Estas tecnologías ofrecen ventajas significativas, como una mayor eficiencia, una creatividad mejorada en la generación de vectores de ataque, la capacidad de adaptar los entornos de prueba y el aprendizaje y la adaptación continuos al panorama de amenazas en evolución. La GenAI promete revolucionar la forma en que se realizan las evaluaciones de seguridad y, en última instancia, reforzar la postura de ciberseguridad de las organizaciones.

Sin embargo, los autores señalan astutamente que esta potente tecnología es un arma de doble filo. La integración de la GenAI en el pentesting también presenta nuevos retos y limitaciones. La dependencia excesiva en la IA, el potencial sesgo de los modelos y las consideraciones éticas y legales son aspectos críticos que deben abordarse. Además, el uso indebido de la GenAI por parte de actores maliciosos para generar amenazas sofisticadas, incluido el malware polimórfico y los ataques persistentes avanzados, supone un riesgo serio.

Hilario et al. subrayan la necesidad de que las organizaciones adopten las mejores prácticas y directrices para aprovechar los beneficios de la GenAI y mitigar al mismo tiempo estos inconvenientes. La transparencia en el uso de la GenAI, delineando claramente sus objetivos, métodos y limitaciones, es crucial. También es esencial dar prioridad a la explicabilidad para garantizar que los expertos en seguridad puedan entender los resultados generados por la IA. También recomiendan la participación activa de los profesionales de la seguridad en el proceso de toma de decisiones, garantizando la supervisión humana y la validación informada de los resultados de la IA. Por último, deben adoptarse medidas estrictas para proteger los datos sensibles a los que se accede durante las pruebas de penetración asistidas por GenAI. Los gobiernos, por su parte, deben buscar un equilibrio entre la limitación de las aplicaciones negativas de la GenAI y el fomento de su potencial positivo.

En Fluid Attacks, apreciamos sinceramente las aportaciones de investigaciones como la de Hilario et al. Como empresa aprobada por CREST que ofrece pentesting como servicio (PTaaS), estamos explorando e implementando activamente los beneficios de la IA en varios aspectos de nuestro trabajo. Aprovechamos nuestros propios modelos de IA para ayudar a nuestros expertos pentesters a priorizar los archivos en función de su probabilidad de contener vulnerabilidades, mejorando así la eficiencia de nuestras evaluaciones. Además, utilizamos GenAI para proporcionar a nuestros clientes asistencia automatizada en la remediación, agilizando así el ciclo de vida de la gestión de vulnerabilidades. Nuestros esfuerzos de investigación y desarrollo también se extienden al apasionante potencial de la IA en la propia detección de vulnerabilidades, con pruebas continuas de modelos innovadores. Creemos que la integración responsable y reflexiva de la IA, como la GenAI explorada en este artículo, es muy prometedora para el futuro de las pruebas de penetración y la ciberseguridad en su conjunto.

Empieza ya con el PTaaS de Fluid Attacks

Suscríbete a nuestro boletín

Mantente al día sobre nuestros próximos eventos y los últimos blog posts, advisories y otros recursos interesantes.

Otros posts